聯(lián)系我們

Contact Us公司總機(jī):020-8998-6280

技術(shù)熱線:020-3893-9734

技術(shù)郵箱:support@tronlong.com

銷售郵箱:sales@tronlong.com

7B/1.5B模型!DeepSeek實(shí)測10.5Tokens/s,RK3576/RK3588本地部署

2025/03/11

引言

DeepSeek的免費(fèi)開源使得AI需求猛增,各個行業(yè)應(yīng)用都在積極接入DeepSeek,為能源電力、智能制造、智慧醫(yī)療等工業(yè)應(yīng)用賦能。

創(chuàng)龍科技基于瑞芯微RK3576和RK3588國產(chǎn)平臺對DeepSeek-R1的7B和1.5B模型進(jìn)行了全面的性能測評,并整理完整的本地部署測評步驟,提供所需的完整測試文件,方便用戶進(jìn)行快速評估。

下文為DeepSeek本地部署測評的簡要步驟,如需完整PDF文檔、完整測試文件(例如7B、1.5B模型文件),請?jiān)谌缦骆溄酉螺d:百度網(wǎng)盤鏈接:https://pan.baidu.com/s/1CUKzP3mrpBTqiNNsXO-D3Q提取碼:xhr8

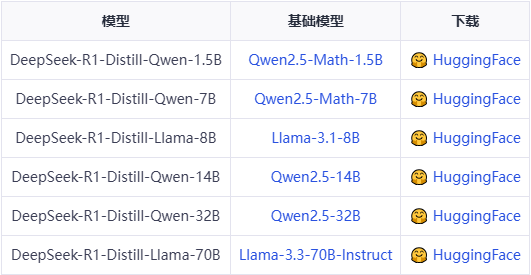

一、DeepSeek-R1模型簡介

DeepSeek-R1是深度求索(DeepSeek)公司推出的開源大語言模型,是一個兼具強(qiáng)推理能力和任務(wù)廣泛適用性的高效模型。DeepSeek-R1基于開源模型進(jìn)行了微調(diào),根據(jù)不同參數(shù)量提供了1.5B至32B等多個版本的模型,滿足不同場景下對于計(jì)算資源和性能的需求,讓DeepSeek的部署與應(yīng)用更加靈活。

圖 1 DeepSeek-R1模型

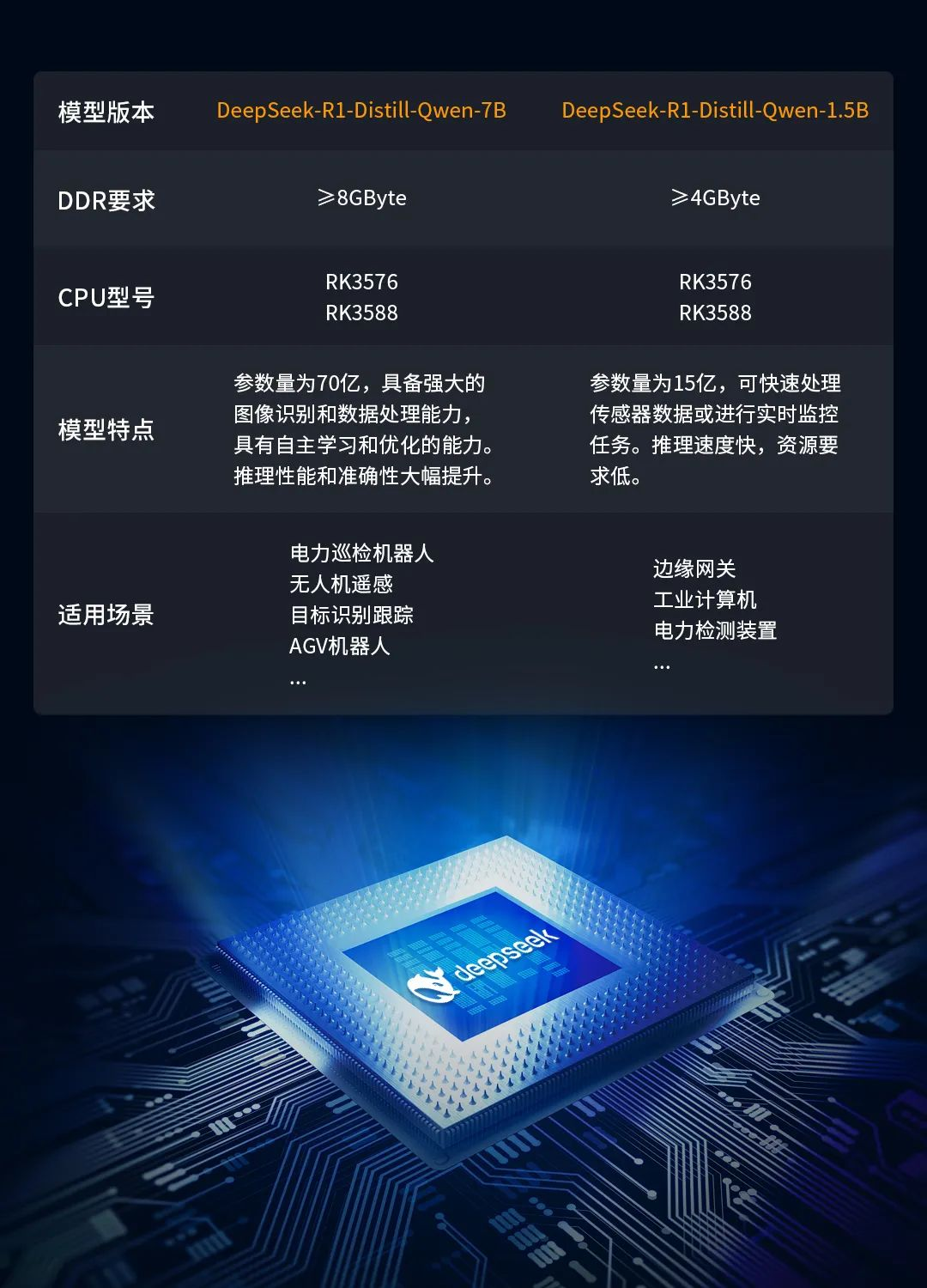

圖 2 7B/1.5B模型特點(diǎn)與要求

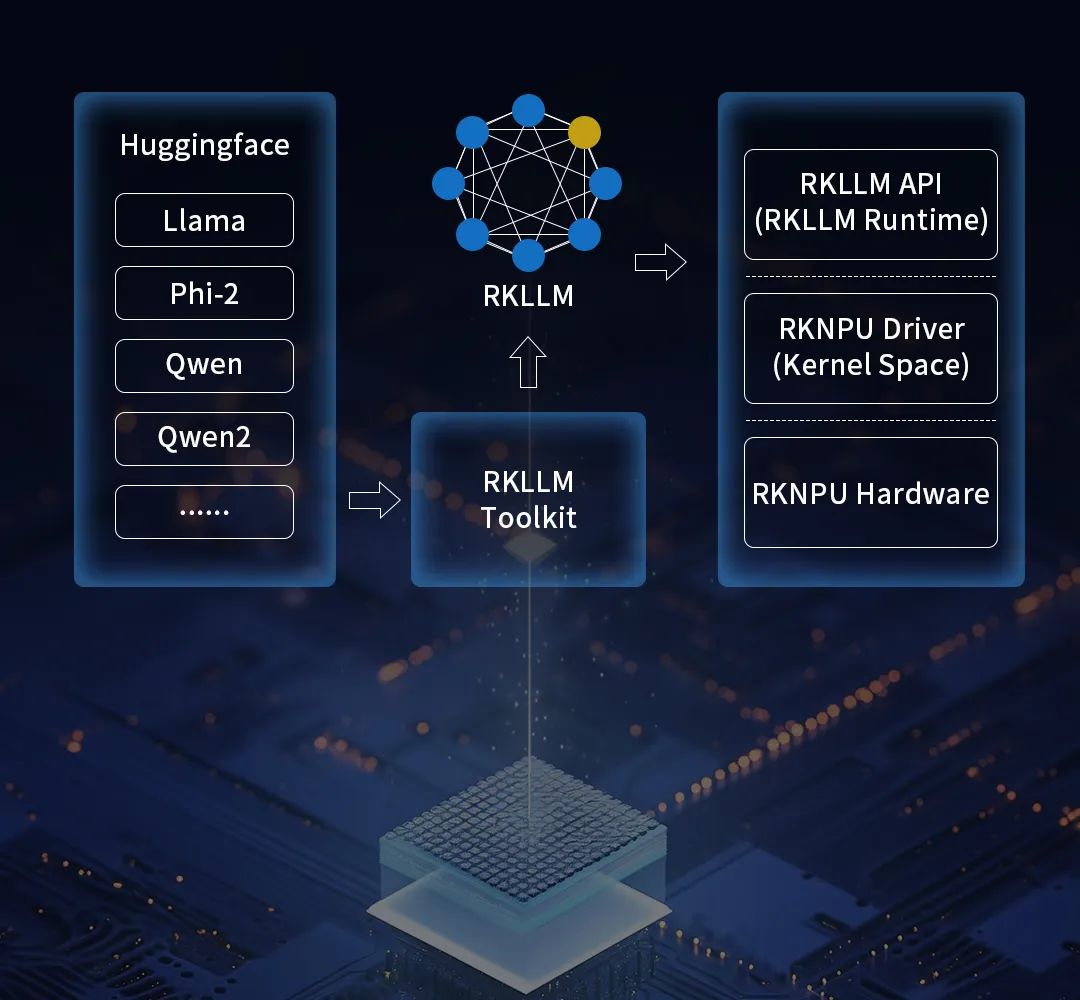

二、DeepSeek模型部署方案

瑞芯微RK3576為4核Cortex-A72@2.2GHz + 4核Cortex-A53@2.0GHz + 6TOPS算力NPU處理器,RK3588為4核Cortex-A76@2.4GHz + 4核Cortex-A55@1.8GHz + 6TOPS算力NPU處理器,它們在能源電力、工業(yè)控制、智慧醫(yī)療、儀器儀表等領(lǐng)域有著廣泛應(yīng)用。

一般有2種部署DeepSeek的方案,分別是“RKLLM量化部署”和“Ollama部署”。為了將RK3576/RK3588強(qiáng)悍的NPU性能發(fā)揮出來,推薦使用“RKLLM量化部署”方案。RKLLM量化部署:瑞芯微官方的RKLLM量化部署,使用NPU運(yùn)行,適用于RK3576、RK3588處理器平臺。Ollama工具部署:Ollama是一個開源的大模型服務(wù)工具,使用CPU運(yùn)行,適用于通用處理器平臺。

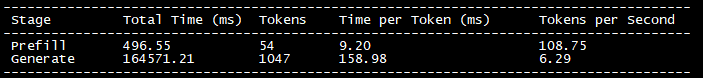

三、7B/1.5B模型性能測評數(shù)據(jù)

以下為RK3576/RK3588基于“RKLLM量化部署”方案的7B/1.5B模型的性能測評詳細(xì)數(shù)據(jù)。

圖 3 7B/1.5B模型性能測評數(shù)據(jù)

四、RKLLM量化部署

RKLLM-Toolkit是瑞芯微提供給用戶在計(jì)算機(jī)上進(jìn)行大語言模型量化、轉(zhuǎn)換的開發(fā)套件,通過RKLLM-Toolkit提供的接口可便捷地完成模型轉(zhuǎn)換和模型量化功能。

RKLLM-Toolkit支持將Hugging Face模型或GGUF模型轉(zhuǎn)換為適配瑞芯微NPU的RKLLM模型。RKLLM Runtime負(fù)責(zé)加載RKLLM-Toolkit轉(zhuǎn)換得到的RKLLM模型,并在RK3576/RK3588本地通過調(diào)用NPU驅(qū)動,加速RKLLM模型的推理。

(1)獲取原始模型

以RK3576平臺 + 1.5B模型為例,在Ubuntu上位機(jī)執(zhí)行如下命令,下載原始模型文件。

Host# git clone https://huggingface.co/deepseek-ai/DeepSeek-R1-Distill-Qwen-1.5B

(2)RKLLM工具安裝

在Ubuntu上位機(jī)創(chuàng)建Python虛擬環(huán)境,并執(zhí)行如下命令安裝RKLLM-Toolkit工具。

Host# pip3 install rkllm_toolkit-1.1.4-cp38-cp38-linux_x86_64.whl

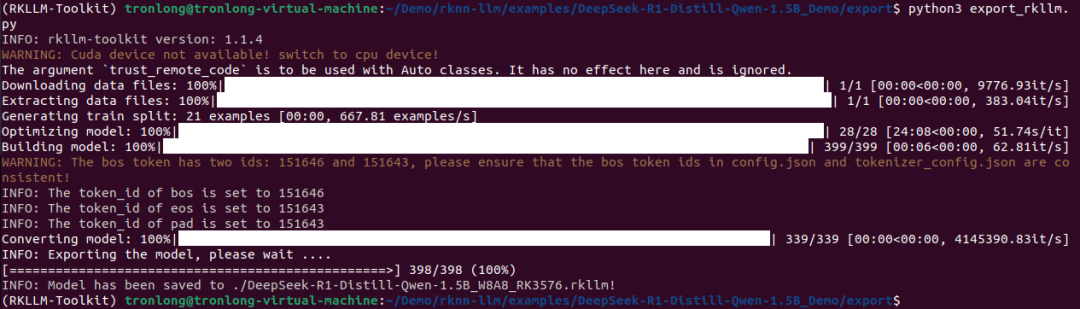

(3)模型轉(zhuǎn)換

然后使用RKLLM-Toolkit工具將Hugging Face模型轉(zhuǎn)換為適配瑞芯微NPU的RKLLM格式。然后修改export_rkllm.py文件中的模型路徑、平臺名稱以及NPU核心數(shù)量,再執(zhí)行如下命令運(yùn)行export_rkllm.py文件將模型導(dǎo)出。

Host# python3 export_rkllm.py

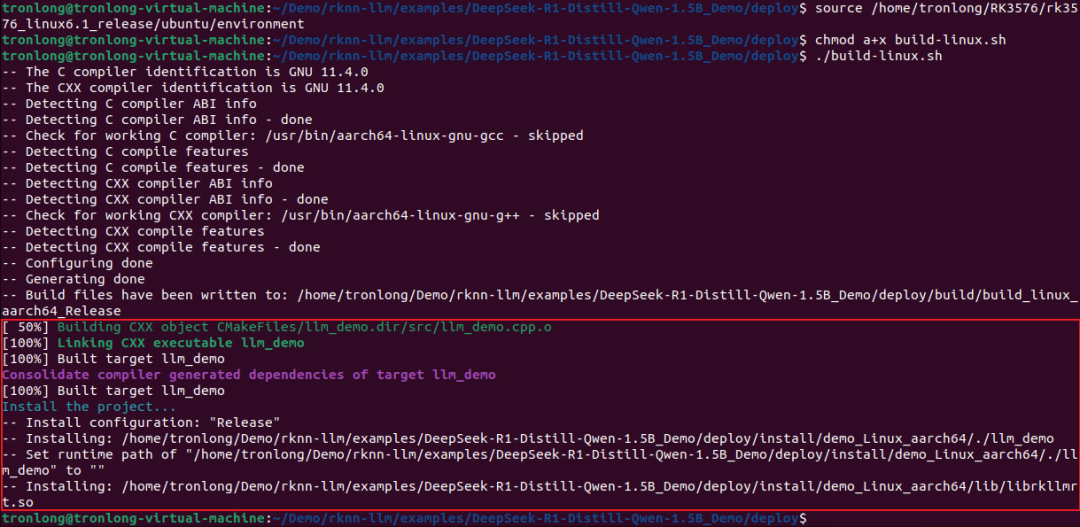

(4)程序編譯

在Ubuntu上位機(jī)執(zhí)行如下命令配置交叉編譯環(huán)境,并運(yùn)行build-linux.sh腳本編譯RKLLM Runtime可執(zhí)行文件。編譯完成后,將會在install目錄生成模型可執(zhí)行程序以及動態(tài)庫。

Host# source /home/tronlong/RK3576/rk3576_linux6.1_release/ubuntu/environmentHost# ./build-linux.sh

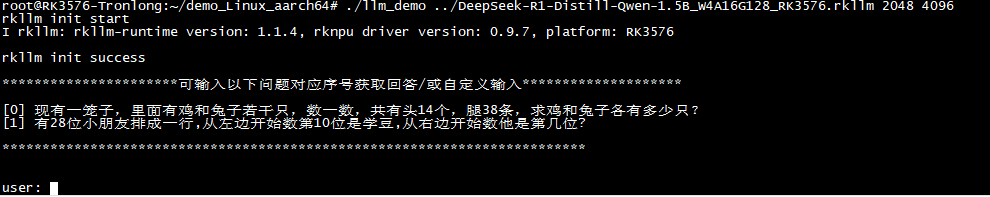

(5)運(yùn)行測試

將案例"bin/rkllm/"目錄下的整個demo_Linux_aarch64文件夾,以及"bin/rkllm/deepseek_model/"目錄下的DeepSeek-R1-Distill-Qwen-1.5B_W4A16G128_RK3576.rkllm模型拷貝至評估板文件系統(tǒng)。然后再將"demo_Linux_aarch64/lib/"目錄的librkllmrt.so動態(tài)庫拷貝至估板文件系統(tǒng)lib目錄下。

在demo_Linux_aarch64目錄下執(zhí)行如下命令,加載與測試部署在評估板的DeepSeek-R1模型。

Target# ./llm_demo ../DeepSeek-R1-Distill-Qwen-1.5B_W4A16G128_RK3576.rkllm 2048 4096

圖 8

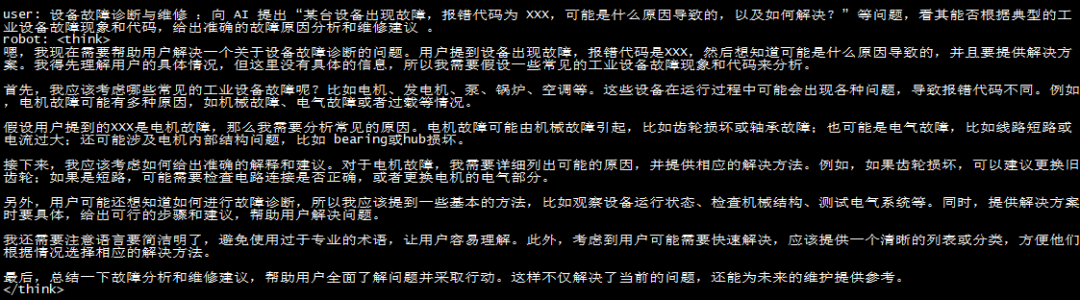

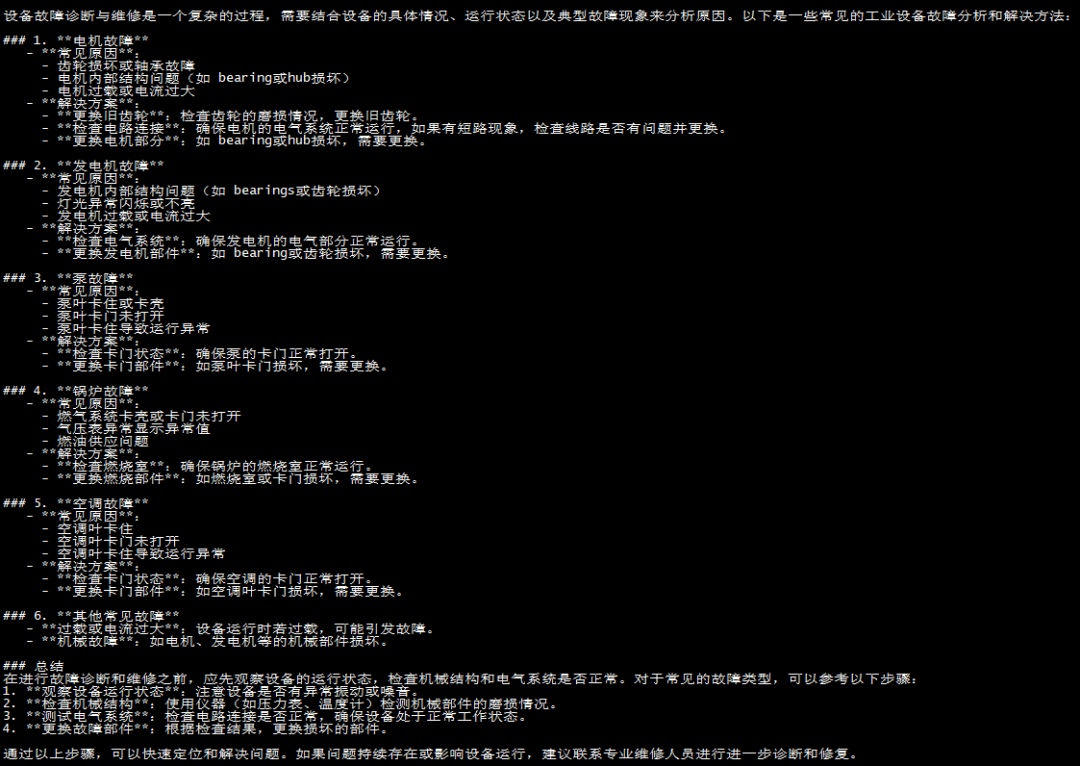

輸入推理測試問題:設(shè)備故障診斷與維修:“某臺設(shè)備出現(xiàn)故障,報(bào)錯代碼為XXX,可能是什么原因?qū)е碌模约叭绾谓鉀Q?”等問題,能否根據(jù)典型的工業(yè)設(shè)備故障現(xiàn)象和代碼,給出準(zhǔn)確的故障原因分析和維修建議。

推理測試效果如下所示。

圖 9

如需查看RKLLM的推理性能(僅適用基于RKLLM量化部署),請?jiān)谶\(yùn)行DeepSeek-R1模型前執(zhí)行如下命令,即可在每次推理完成后顯示Prefill與Generate階段的Token數(shù)量與推理耗時。

Target# export RKLLM_LOG_LEVEL=1

圖 11 RK3576

五、Ollama部署方案

Ollama是一個開源的本地大語言模型運(yùn)行框架,專為在本地設(shè)備上便捷部署和運(yùn)行大型語言模型(LLM)而設(shè)計(jì),支持在X86/ARM架構(gòu)設(shè)備上零配置運(yùn)行AI大模型。

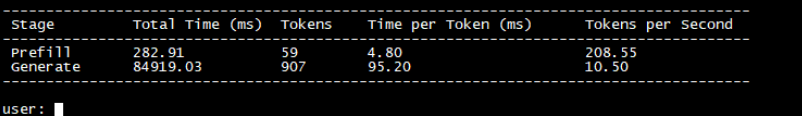

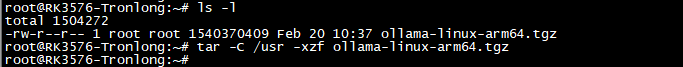

(1)Ollama安裝

將案例"bin\ollama\"目錄下的ollama-linux-arm64.tgz壓縮包拷貝至評估板文件系統(tǒng),執(zhí)行如下命令解壓。解壓完成后,請重啟評估板。

Target# tar -C /usr -xzf ollama-linux-arm64.tgz

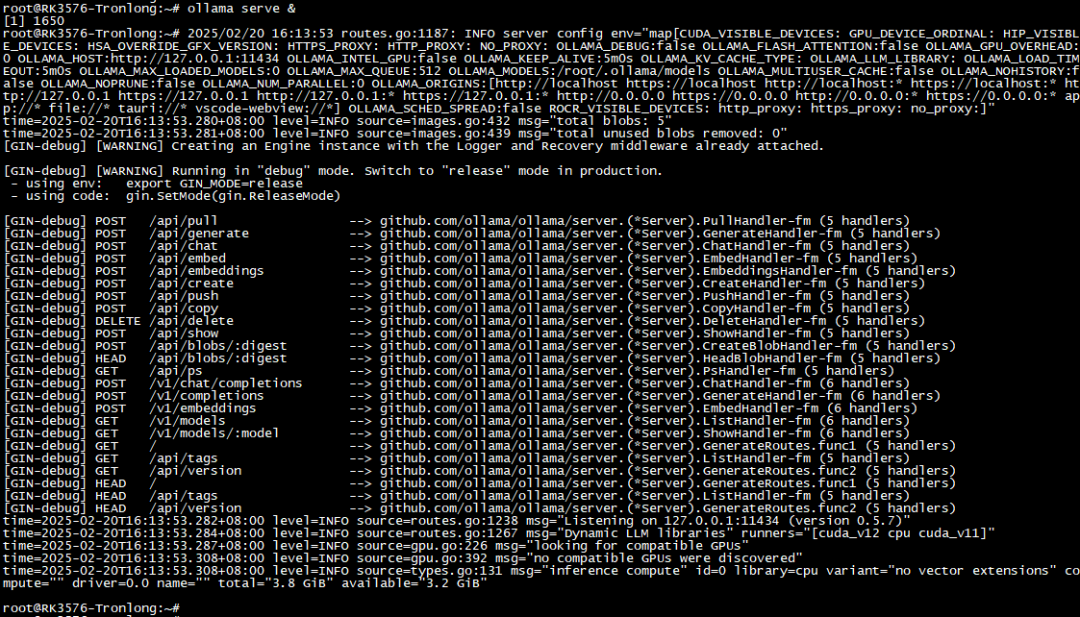

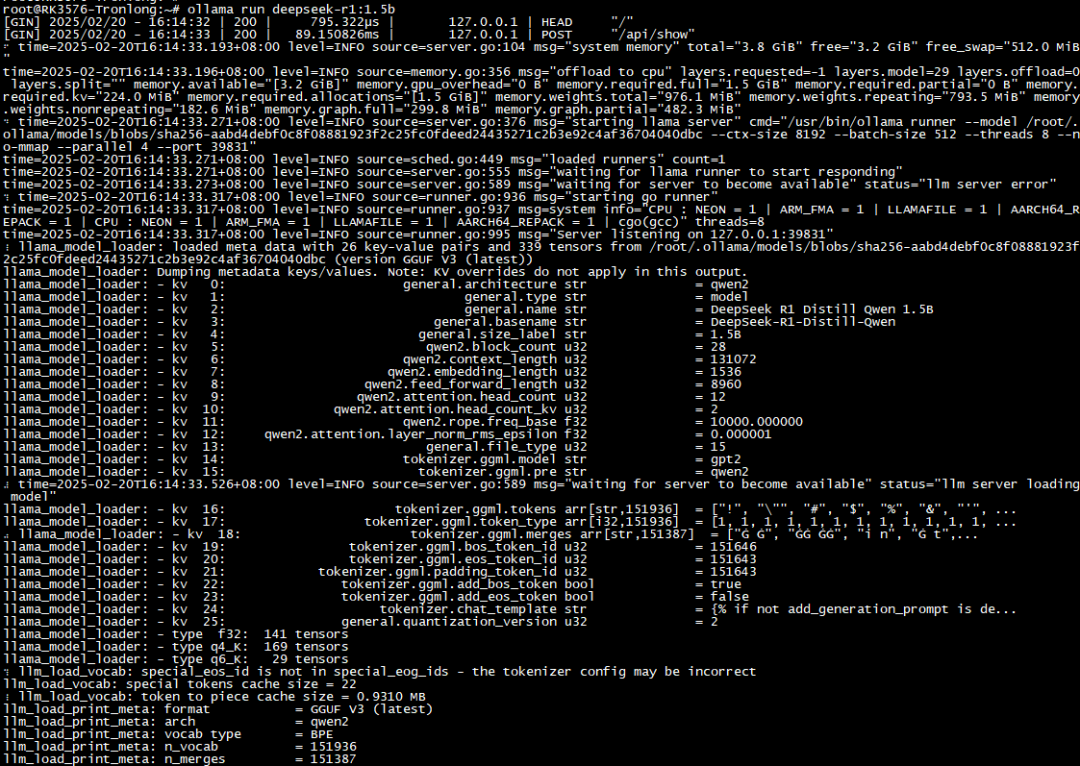

(2)啟動Ollama服務(wù)

進(jìn)入評估板文件系統(tǒng),執(zhí)行如下命令,啟動Ollama服務(wù)。

Target# ollama serve &

(3)運(yùn)行模型

執(zhí)行如下命令,使用Ollama運(yùn)行deepseek-r1:1.5b模型。

Target# ollama run deepseek-r1:1.5b

如需更多RK3576/RK3588全國產(chǎn)工業(yè)核心板相關(guān)資料,可掃描下方二維碼下載,快來試試吧!

服務(wù)熱線

服務(wù)熱線